News Information

一、从世界巨头寻找发展的足迹

1、GPU的作用与分类

GPU(graphicsprocessingunit,图形处理器)又被称为显示芯片,多用于个人电脑、工作站、游戏主机以及移动设备(智能手机、平板电脑、VR设备)上专门运行绘图运算的微处理器。

结构决定GPU更适合并行计算,GPU与CPU主要区别在于片内的缓存体系和数字逻辑运算单元的结构差异:GPU核(尤其ALU运算单元)的数量远超CPU但是结构较CPU简单,因此被称为众核结构。众核结构非常适合把同样的指令流并行发送到众核上,采用不同的输入数据执行,从而完成图形处理中的海量简单操作,如对每一个顶点进行同样的坐标变换,对每一个顶点按照同样的光照模型计算颜色值。GPU利用自身处理海量数据的优势,通过提高总的数据吞吐量(Throughput)来弥补执行时间(Latency)长的缺点。

一般而言,消费者在选购消费电子产品的时候,例如在选购移动电话或者笔记本时,会更加关注CPU(CentralProcessingUnit,中央处理器)的性能,例如CPU的品牌、系列、核心数量等等,而GPU受到的关注就相对较少。GPU(GraphicProcessingUnit),及图形处理器,是一种专门在个人电脑、工作站、游戏机和一些移动设备(如平板电脑、智能手机等)上做图像和图形相关运算工作的微处理器。在PC诞生之初,并存在GPU的念,所有的图形计算都由CPU进行计算。然而,使用CPU做图形计算速度较慢,于是就设计了专门的图形加速卡用以帮助处理图形计算。再后来,NVIDIA提出了GPU的概念,将GPU提升带了一个单独的计算单元的地位。

CPU一般由逻辑运算单元、控制单元和存储单元组成。CPU虽然有多核,但总数没有超过两位数,每个核都有足够大的缓存;CPU有足够多的数字和逻辑运算单元,并辅助有很多加速分支判断甚至更复杂的逻辑判断的硬件。因此,CPU拥有超强的逻辑能力。GPU的优势在于多核,核数远超CPU,可以达到数百个,每个核拥有的缓存相对较小,数字逻辑运算单元少且简单。因此,GPU相对于CPU更适用于处理数据并行计算问题。

CPU与GPU的区别

| - | CPU | GPU |

| 设计目标 | 侧重于程序执行的效率 | 重在对大量趋同计算的并行处理 |

| 运行复杂程度高,需要处理各种不同的数据行,同时逻辑判断有需要处理大量分支跳转和中断 | 运行复杂度低,面对的是不被打断的计算环境,处理类型统一的、无相关性的大规模数据 | |

| 内部架构 | 大部分晶体管用于控制,缓存的等的设计,负责算数逻辑的处理单元不多 | 大部分的警惕管用于算数逻辑处理单元 |

| 逻辑核心复杂 | 逻辑核心简单 | |

| 适用任务 | 适合运行具有分支密集型,不规则数据结构、逻辑更加灵活复杂等特点的串行程序。 | 合适处理计算密集型、数据耦合度低、高度并行化的计算任务 |

GPU具有两种分类方式,一种根据与CPU的关系,另一种是根据GPU所在的应用端类别。根据与CPU的关系,GPU可以分为独立CPU和GPU。独立GPU一般焊接在显卡的电路板上,位置在显卡的风扇下面。独立GPU使用的是专用的显示存储器,显存带宽决定了和GPU的连接速度。集成GPU一般与CPU集成在一起。集成GPU与CPU共有一个风扇和缓存。集成GPU由于设计制作、驱动程序都由CPU厂家完成,因此兼容性较好;此外,由于CPU与GPU实现了集成,因此,集成GPU的占用空间小;实现GPU与CPU的适配与兼容,集成GPU的性能相对独立GPU较弱,因此功耗和成本相对独立GPU较低。独立GPU由于拥有独立的显存,更大的空间和更好的散热,因此在性能上面独立显卡更好;但需要额外的空间,能够满足复杂庞大的图形处理需求,并提供高效的视频编码应用。然而,强劲的性能意味着更高的耗能,独立GPU需要额外的供电,并且成本也更高。

集成显卡与独立显卡的区别

| 区别 | 集成显卡 | 独立显卡 |

| 与CPU的关系 | 集成在CPU里面的图像处理单位,构成CPU的一部分 | 单独插在主板上的图像处理单位,其接口是PCIE接口,是一个单独的电脑组件 |

| 价格 | 低 | 高 |

| 兼容性 | 较好 | 较差 |

| 性能 | 较差 | 较好 |

| 升级成本 | 低 | 高 |

| 功耗 | 低 | 高 |

| 是否占用电脑内存 | 是 | 否 |

| 主要生产商与产品 | Intel(HD系列)、AMD(APU系列) | AMD(Radeon系列),NVIDIA(GeForce系列) |

| 主要应用领域 | 移动计算市场,如笔记本和智能手机 | 高性能游戏电脑,VR/AR,人工智能 |

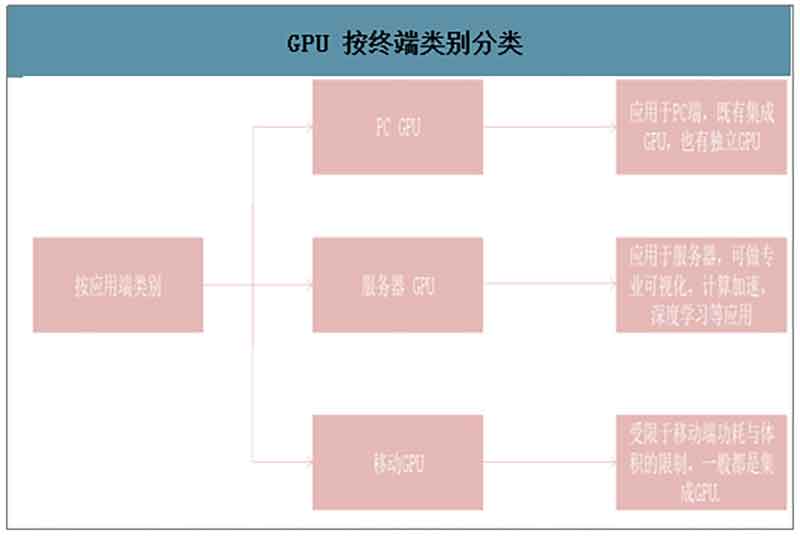

根据应用终端类别,可以分为PCGPU,服务器GPU,移动GPU。PCGPU应用于PC端。根据其所在产品定位既可以使用集成GPU,也可以使用独立GPU。例如,若PC以轻办公,文字编纂为主,一般产品会选择搭载集成GPU;若PC需要制作高清图片,编辑视频,渲染游戏等,则选择的产品搭载独立GPU。服务器GPU应用于服务器,可做专业可视化、计算加速、深度学习等应用,根据云计算、人工智能等一系列技术的发展,服务器GPU将会以独立GPU为主。移动端轻薄化已经成为趋势,终端内部净空间由于多种功能模组的增加已经快速下降;同时就目前移动端需要处理的视频和图像而言,集成GPU已经能够满足。所以移动GPU一般采用集成GPU。

GPU按终端类别分类

2、GPU市场:寡头竞争时代已经来临

PCGPU市场,Intel优势明显。智研咨询发布的《2020-2026年中国GPU行业市场竞争格局及行业发展前景预测报告》显示:全球2019年第四季度PC领域GPU出货量,Intel是全球最大的处理器供应商。目前主流的处理器架构是X86,主要的供应商是Intel,AMD,VIA。截至2019年第四季度,消费级x86CPU市场中,包括桌面品台,移动端平台(笔记本和平台LOT物联网)中,Intel占据了84.4%的市场份额,AMD占据了15.5%的市场份额。Intel凭借在CPU出货量上的优势,通过销售集成GPU,实现了在GPU市场的霸主地位。Intel以63%的市场份额排名第一,对比2019年第三季度环比下滑了2个百分点;AMD作为全球第二大的X86架构处理器供应商,既受益于CPU出货带动的集成GPU出货量,也受益于自身优秀的独立GPU的出货。

AMD以19%的市场份额排名二,环比上升3个百分点;NVIDIA是全球领先的独立GPU供应商,同时结合ARM架构处理器,出货集成GPU,市场份额为18%,环比下降了1个百分点。

全球PCGPU市场份额

Intel与AMD处理器出货量之间的对比

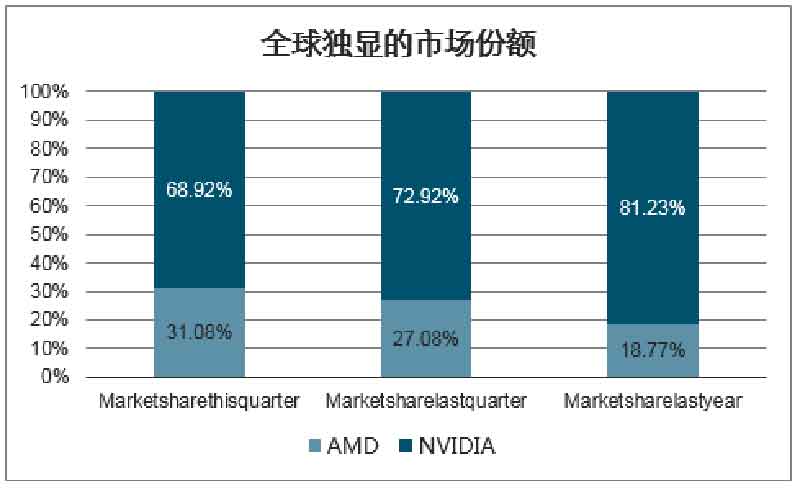

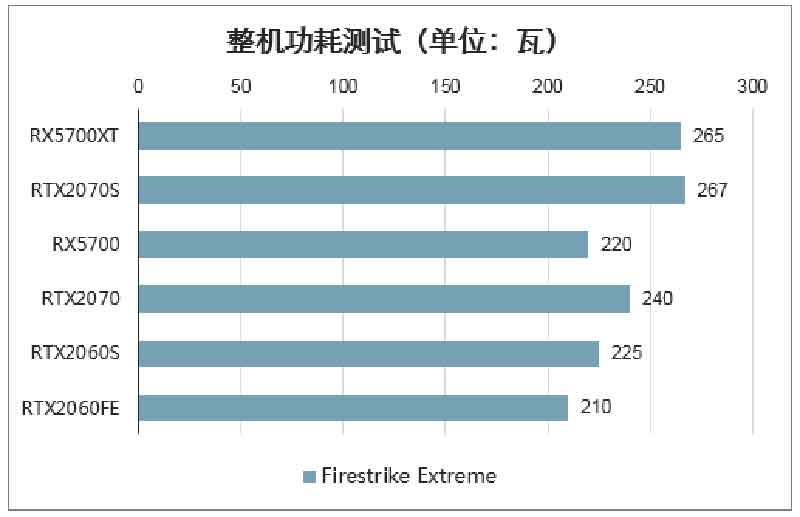

独立GPU领域,AMD奋起直追。截至2019年第四季度,在独立GPU域中,NVIDIA以68.92%的市场份额占据较大的优势。AMD方面,AMD得益于在2018Q4所推出RX5500及RX5600系列,以及RX5700系列的放量,多方因素共同促使AMD显卡份额大涨,从2018年18.77%上升至31.08%。AMD推出的Radeon系列部分型号采用7nm工艺,并且在与NVIDIA的产品对比中(RTX2070对标RX5700,RTX2070S对标5700XT),同系列AMD性能略强,价格更低,重点是功耗一样。更强的性能,更低的功耗,AMD的产品无疑对NVIDIA的市场份额造成了挑战。

全球独显的市场份额

NVIDIA与AMD产品性能对比

整机功耗测试(单位:瓦)

五雄争霸,手机厂商不甘寂寞。在移动GPU领域,主要以Imagination、ARM、Qualcomm、Vivante、NVIDIA为主。高通目前是Android阵营最大的处理器供应商。移动端主要使用集成GPU,因此,高通GPU因其处理器的市场优势也有所受益。ARMMailGPU的主要使用者是华为和三星。ARMMail的GPU性能相对较弱,因此华为在2018年通过推出GPUTurbo软硬件优化弥补短板。三星方面已经与AMD前敌多年的IP授权,AMD将向三星授权最新的7nmRDNA架构Radeon显卡IP,并且尝试自研GPU。苹果在与Imagination取消合作两年后,再次选择与Imagination合作,并给予支付授权费。虽然目前手机巨头都是采取购买GPU厂商IP的方式,但是目前三星、苹果、华为等有相关计划进行GPU自研项目。手机已经进入同质化时代,手机之间的差异性已经成为手机厂商竞争优势的关键。公版GPU难以使手机厂商产生本质的差异性。因此,手机需要通过自研GPU以及CPU实现手机性能的差异化,从而获得市场的竞争优势。

全球移动GPU主要供应商

厂商 | GPU核心 | 授权商 |

Imagination | PowerVR系系列列,SGX | Intel、联发科、LG、高通、瑞萨、三星、海思 |

ARM | Mail系列 | 三星、海思、瑞芯微、展讯、意法半导体、全志 |

Qualcomm | Adreno系列 | 自用、不对外授权 |

Vivante | GC系列 | 飞思卡尔、军政、Marvell |

NVIDIA | Geforce系列、Tegra | 开普勒架构已对外授权 |

二、中国GPU服务器

1、中国GPU服务器市场发展规模

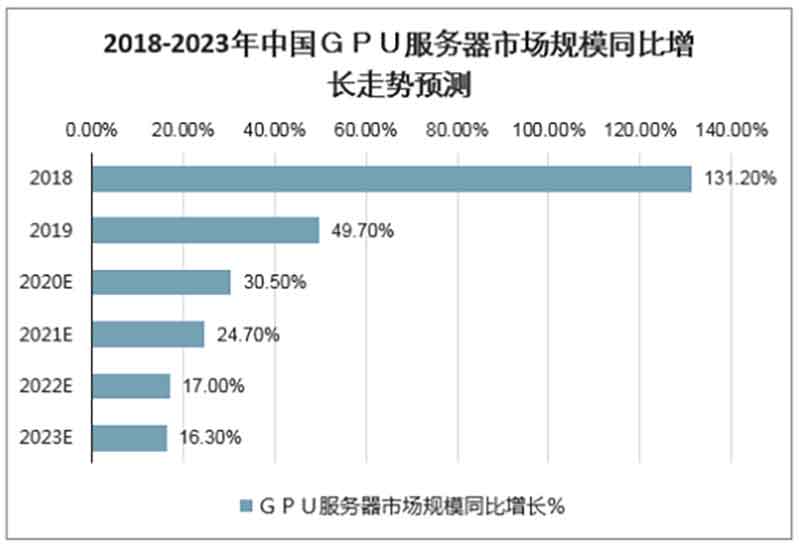

2018年下半年中国GPU服务器市场规模为7.8亿美金(约合人民币53.8亿元),同比增长107.3%。 2018年全年中国GPU服务器市场规模为13.05亿美金(约合人民币90.05亿元),同比增长131.2%。IDC预测,到2023年中国GPU服务器市场规模将达到43.2亿美金(约合人民币298亿元),未来5年整体市场年复合增长率(CAGR)为27.1%。

2018-2023年中四GPU服务器市场规模同比增长走势预测

2018年中国GPU服务器市场量价齐升,出货量和销售额均实现快速增长。

从行业来看,互联网为主要采购行业,占据60%以上的市场份额,是拉动市场增长的主要行业;政府的采购量也有所上升,超过了10%的市场份额;

从产品来看,4卡及以上GPU服务器占据了8成以上的市场份额,其中4卡、8卡、16卡均占有20%以上的市场份额;

从厂商来看,浪潮、华为和曙光在出货量和销售额方面均位列市场前三;

从市场趋势来看,AI服务器和边缘计算服务器等面向特定工作负载的细分服务器市场迎来爆发,各大厂商加速布局该领域并推出新产品,2019年这些细分市场仍将是市场的热点。

2018年中国GPU服务器厂商市场份额情况

“计算和数据是人工智能不可缺少的组成部分。2018年,人工智能的发展引领中国GPU服务器市场的高速增长;训练依然是GPU服务器的主要工作负载,未来几年推理工作负载的服务器也会逐渐上升;在深度学习的不断推动下人工智能取得重要突破;到目前为止,除了专业人工智能公司以外,许多大型公司也同时开始涉足深度学习,并应用在广泛的商业实践中。2018年以前,互联网是GPU服务器的主要采购行业,如今,许多传统行业对GPU服务器也慢慢有所需求,尝试将人工智能技术与自己的行业相结合。由此看来,GPU服务器市场规模还有很大上升空间。

2、GPU将在数据中心长足发展

GPU在A.I数据中心领域对A.I专用芯片的技术突袭防御性较强。相比于由图形处理器演进而来的GPU,当前许多公司基于FPGA、ASIC从事A.I专用芯片研发,以挑战GPU在A.I领域的霸主地位, GPU在A.I数据中心领域对A.I专用芯片的防御性较强。GPU的性能特点与A.I数据中心对处理器的需求非常契合,并且在长时间的发展中已经形成了完整的生态,相比较而言,无论是FPGA、还是ASIC路线A.I专用芯片,都尚处于发展阶段,而要成功打造一款通用芯片,时间的积淀非常重要。

GPU具有较为完整的技术生态。高运算性能硬件、驱动支撑、API接口、通用计算引擎/算法库、较为成熟的开发环境都为应用GPU的深度学习开发者提供了足够友好、易用的工具环境。开发者可以迅速获取到深度学习加速算力,降低了深度学习模型从研发到训练加速的整体开发周期。

驱动程序,独立显卡厂商不仅提供高性能硬件,也一直提供配套驱动来支持其GPU调用计算资源。早期图形处理、游戏业务的优势地位使得英伟达一直在GPU驱动下了不少功夫,公司总部大多数员工都是从事驱动程序的研发工作。从图形接口API来看,不同的独立显卡厂商提供不同的图形标准API,而不同的API接口适应于不同的计算系统,如OpenGL标准支持Unix系统的服务器计算平台,Direct3D支持windows系统的PC。英伟达推出的CUDA(ComputeUnifiedDeviceArchitecture)通用并行计算平台,是为利用GPU并行运算能力开发的计算平台。可以让开发人员用C语言编写的程序在其处理器上高速运行,大大提升了通用GPU的易用性。

算法库,CUDA包括了大量的GPU加速库和基于C语言的编程工具,开发者可以在熟悉的编程环境下便捷地调用加速库。CUDA提供的算法库可以让应用程序像调用库函数一样简单实现一些深度学习算法。CUDA开发人员的数量在5年里增长了14倍,超过60万人,CUDASDK的下载量达到180万。众多CUDA开发人员对于维持英伟达GPU客户黏性非常重要。

GPU完整的技术生态,吸引了大量A.I企业采用GPU进行人工智能加速,建立了良好的行业生态。英伟达与科研机构开展合作项目,深入了解科研领域需要的运算问题,为其提供专业的超级计算加速解决方案。英伟达与不同应用领域的企业合作,如医疗、金融、天气等,开发面向不同领域的加速产品。截止2016年底,与英伟达合作开发深度学习项目的公司已经达到了19,439家。除了传统的互联网巨头公司以外,还有很多创业公司,用于图像识别、语音识别、自然语言处理、计算机视觉、搜索引擎、医学成像、机器人、数据挖掘等应用加速。

GPU浮点运算能力

GPU的高运算性能使其迅速占领A.I数据中心市场,完备的生态环境可帮助其维持霸主地位。从上图可以看出,GPU的浮点运算能力一直保持着直线上升。英伟达在2017年GPU技术大会上发布的全新一代人工智能GPU芯片—TeslaV100能够达到15Tflops的单精度浮点性能,7.5Tflops的双精度浮点性能,可以满足当前A.I深度学习的运算能力。GPU持续提升的运算能力是其维持在A.I数据中心这一运算密集型应用场景中霸主地位的根本,而面对众多新兴A.I芯片的挑战,GPU已经建立起的完备的生态环境可帮助其提高防御能力。

GPU的生态环境有利于其将在训练学习领域(A.I数据中心)建立的优势延续至推理应用领域(前端电子产品)。当前GPU已经占据了A.I数据中心市场,学习阶段处理器需求已经被GPU占领。未来随着A.I行业应用的逐渐落地,推理阶段处理器需求将持续放量。从学习到推理阶段,算法部署的平滑、便捷性是需要考虑的重要问题。如果从数据中心、云端到前端应用,整个产品线都采用英伟达的CUDA计算平台,可以极大地减少算法跨平台的难度,实现平滑过渡,省去了变更运行环境所需的协同工作。

相比较而言,无论是FPGA、还是ASIC,都尚处于发展阶段。目前有一些公司基于FPGA技术路线或ASIC技术路线开发的A.I专用芯片,是为满足自身的需求而进行的个性化开发。典型的就是谷歌的TPU,公司并没有计划将其做成一款通用芯片推向市场。有些公司也在基于FPGA或ASIC开发通用的A.I专用芯片,但是都未达到GPU的成熟程度。一款芯片要做的具有通用性,性能稳定优异,需要较长时间的应用、优化、验证。但是不可否认的是,长期来看,GPU能耗高、价格贵等问题也给A.I专用芯片留下了机会。

A.I数据中心需求增加。当前深度学习对海量数据的处理需求,需要专业的A.I数据中心来支撑。随着A.I的纵深发展,未来A.I数据中心的数据、流量和处理能力也将随之提升,对专业数据中心需求将会增多。具体表现为:当前许多从事A.I研发的互联网巨头,像亚马逊、百度、腾讯等,都已部署自己的数据中心,并尝试承载A.I业务,许多A.I潜在应用行业客户尚未部署自己的A.I数据中心。随着A.I行业应用继续深入发展,A.I数据中心的数量和规模将会持续增加。预测到2020年超大规模数据中心将占全部数据中心服务器安装量的47%,达到485个。预计专业的A.I数据中心增长趋势与之相同,未来几年A.I数据中心也呈现直线上升。

超大规模数据中心数量走势预测(个)

<p style="margin-top:20px;margin-bott